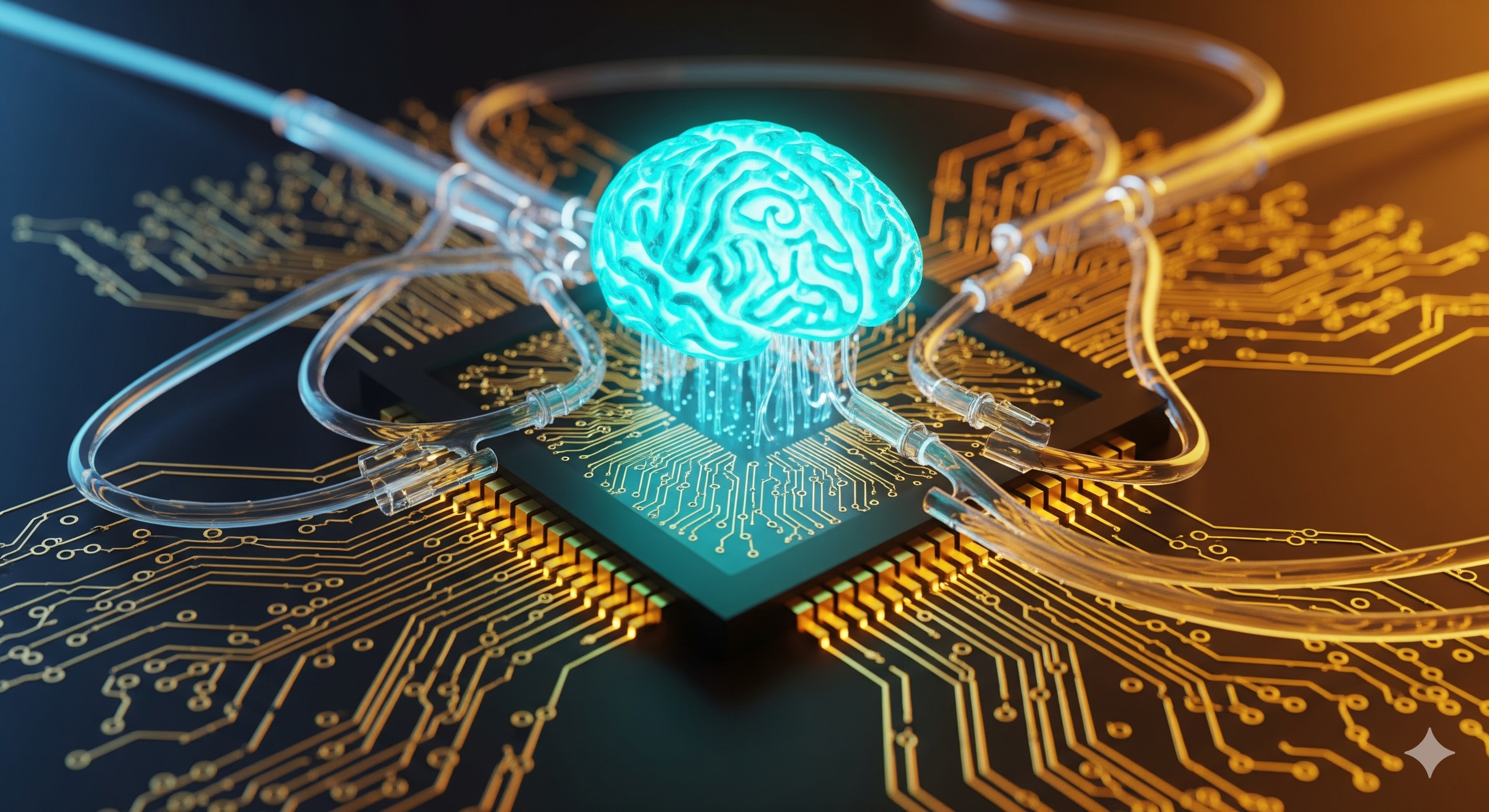

Novedades de Gemini 3.1: Agentes Nativos y Memoria Dinámica

Publicado el 23 de febrero de 2026

¿Alguna vez has sentido que la IA avanza tan rápido que pestañear significa perderse una revolución entera? Pues acomódate frente al ordenador, porque la actualización que Google acaba de desplegar hoy con Gemini 3.1 no es un simple lavado de cara. Es un cambio de paradigma en cómo los desarrolladores integramos la inteligencia artificial en nuestros productos.

Si la versión 3.0 nos trajo la consolidación del razonamiento nativo multimodal, Gemini 3.1 viene a resolver los "dolores de cabeza" del día a día: orquestación de agentes, latencia en tiempo real y gestión de memoria a largo plazo. Vamos a destripar las novedades más jugosas que trae esta nueva versión bajo el capó.

1. Memoria Epistémica y Contexto Dinámico

Hasta ahora, lidiábamos con ventanas de contexto masivas (esos 10 millones de tokens que nos volaron la cabeza el año pasado). Pero el problema persistía: procesar todo ese contexto en cada llamada era costoso y lento. Gemini 3.1 introduce lo que han bautizado como Memoria Epistémica Dinámica.

- Retención de estado nativa: Ya no necesitas enviar todo el historial de la conversación o los documentos en cada petición de la API. El modelo ahora mantiene un "espacio de trabajo" persistente asociado a un ID de sesión.

- RAG integrado y transparente: El propio modelo decide cuándo buscar en su memoria a largo plazo y cuándo procesar el input inmediato. Esto significa que ya no tienes que construir bases de datos vectoriales complejas para tareas sencillas; Gemini gestiona qué recordar y qué descartar, reduciendo los costes de inferencia hasta en un 40%.

2. Orquestación de Agentes "Out of the Box"

Se acabó tener que montar frameworks de terceros complejísimos (como LangChain o AutoGen) para que dos agentes hablen entre sí. Gemini 3.1 incluye una API de Enjambre (Swarm API) nativa.

Ahora puedes instanciar múltiples sub-modelos especializados y dejar que Gemini 3.1 actúe como el director de orquesta. Imagina el siguiente escenario de desarrollo: puedes definir un agente con el rol de desarrollador Senior (equipado con herramientas de ejecución en terminal), otro agente con el rol de QA Tester (cuya misión sea intentar romper ese código) y un orquestador principal.

En lugar de programar la lógica de comunicación entre ellos, simplemente le das al orquestador una tarea compleja (por ejemplo, "Crea una API REST para gestión de usuarios, escribe los tests y verifica que pasen"). Los agentes colaborarán de forma autónoma debatiendo y corrigiendo errores hasta entregarte el reporte final. Todo esto integrado de fábrica, reduciendo drásticamente la complejidad arquitectónica de tus aplicaciones.

3. Multimodalidad de Ultra Baja Latencia (Project Astra Integrado)

Lo que vimos en las demos técnicas de Project Astra por fin se ha democratizado en la API pública. El nuevo modelo Gemini 3.1 Flash-Realtime permite el procesamiento de flujos de audio y vídeo bidireccionales por debajo de los 150 milisegundos.

Casos de uso clave:

- Interfaces de voz fluidas: Aplicaciones que pueden interrumpir al usuario, entender el tono emocional y responder sin el clásico "lag" robótico, logrando conversaciones tan naturales como hablar con un compañero.

- Visión por ordenador en tiempo real: Análisis de vídeo en streaming directamente desde el navegador o dispositivo móvil. Esto es un salto gigante para aplicaciones de accesibilidad (describir el entorno en tiempo real a personas invidentes) o control de calidad en robótica industrial.

4. Mejoras en Tool Use y Sandboxing

Para los que diseñamos arquitecturas de software, la precisión en el uso de herramientas (Tool Use) ha subido de nivel. Gemini 3.1 ahora soporta Llamadas a Funciones Asíncronas, lo que le permite desencadenar múltiples acciones en paralelo (como consultar una base de datos, llamar a una API del clima y enviar un email al mismo tiempo) y esperar los resultados.

Además, se ha mejorado su capacidad para ejecutar acciones en entornos seguros (sandboxes) locales de manera mucho más predecible, y su comprensión de repositorios gigantescos (monorepos) es mucho más fina gracias a un nuevo sistema de atención jerárquica.

Conclusión

Gemini 3.1 no es solo un modelo más inteligente; es un modelo más útil y gobernable. Al integrar la memoria persistente y la orquestación de agentes directamente en su núcleo, Google nos está quitando de encima toneladas de trabajo de infraestructura. La pregunta ya no es qué puede hacer la IA, sino qué vas a construir tú ahora que las barreras técnicas más aburridas han desaparecido.

Foto de Google - Gemini 3.1